AIUC-1: Nowy Złoty Standard dla Godnej Zaufania Sztucznej Inteligencji Korporacyjnej

Zmniejszanie luki zaufania w CX: Odpowiedzialna AI z AIUC-1

Wyobraź sobie dyrektorkę ds. CX, Marię, podczas napiętej wideokonferencji z CEO. "W zeszłym tygodniu nasz chatbot AI błędnie zidentyfikował kluczowego klienta VIP i przypadkowo wysłał mu cennik konkurencji" – warczy CEO. Dane wyciekły; zaufanie klienta zostało zniszczone. W następującym chaosie IT obwinia dział produktu, dział produktu obwinia dział prawny, a zespół marketingowy nawet nie jest pewien, co się stało. Maria boleśnie zdaje sobie sprawę, że izolowane zespoły i przyspieszone wdrożenia AI pozostawiły kluczowe zabezpieczenia danych i prywatności niezdefiniowane – a reputacja jej marki teraz wisi na włosku.

Ten scenariusz to nie fikcja. Gdy chatboty AI, agenci głosowi i silniki rekomendacji zalewają punkty kontaktu z klientami, błędy i nieprzejrzyste praktyki dotyczące danych mogą zniszczyć zaufanie z dnia na dzień. Przedsiębiorstwa stoją przed wyraźnym dylematem: AI obiecuje hiperpersonalizację i efektywność, ale pomyłki (halucynowane odpowiedzi, nieautoryzowane wykorzystanie danych, wycieki własności intelektualnej) mogą nieodwracalnie zaszkodzić doświadczeniu klienta. Liderzy CX i EX potrzebują nowej strategii – ustrukturyzowanych ram do odpowiedzialnego zarządzania AI.

Kluczowe spostrzeżenia:

- Zagrożone zaufanie: Awarie AI (takie jak pewne błędne odpowiedzi lub wycieki danych) bezpośrednio podważają zaufanie i lojalność klientów. Badania pokazują, że 53% konsumentów obawia się, że ich dane osobowe będą niewłaściwie wykorzystywane przez AI, a prawie połowa udostępniłaby więcej danych tylko wtedy, gdyby firmy zapewniły większą przejrzystość i kontrolę.

- Pierwszy standard dla agentów AI: AIUC-1 to pierwszy na świecie kompleksowy standard dla agentów AI, opracowany przez ekspertów ds. bezpieczeństwa i AI w celu rozwiązania problemów na skalę przedsiębiorstwa. Obejmuje kluczowe obszary ryzyka (dane i prywatność, bezpieczeństwo, ochrona, niezawodność, odpowiedzialność, społeczeństwo), tworząc wspólną "infrastrukturę zaufania" dla adopcji AI.

- Obowiązkowe kontrole danych/prywatności: AIUC-1 wymusza surowe wymagania dotyczące danych i prywatności. Na przykład wymaga jasnych polityk dotyczących danych wejściowych/wyjściowych, ograniczeń w zbieraniu danych oraz zabezpieczeń technicznych przed wyciekiem danych osobowych lub tajemnic handlowych. Te zabezpieczenia mają na celu zapobieganie incydentom takim jak ten, którego właśnie doświadczyła firma Marii.

- Certyfikacja i ubezpieczenie: Certyfikacja AIUC-1 oznacza, że system AI przeszedł rygorystyczne testy (tysiące symulowanych awarii w różnych scenariuszach ryzyka). Pierwsi użytkownicy, tacy jak ElevenLabs, uzyskali certyfikaty AIUC-1 i nawet ubezpieczenie AI dla swoich agentów głosowych, sygnalizując klientom i partnerom, że ich AI jest sprawdzone.

- Współpraca jest kluczowa: AIUC-1 został zbudowany przez liderów z Microsoft, Cisco, JPMorgan Chase, UiPath, ElevenLabs i innych, odzwierciedlając konsensus, że bezpieczeństwo AI wymaga działań międzyfunkcyjnych. Ramy takie jak Microsoft's Secure Development Lifecycle dla AI podobnie podkreślają, że bezpieczeństwo musi być sposobem pracy, a nie tylko punktem kontrolnym.

- Pułapki "AI-washingu": Wielu dostawców nakłada etykietę "AI" na produkty bez rzeczywistych danych lub zabezpieczeń, ale klienci szybko to przejrzą. Przesadzone twierdzenia (takie jak "AI klasy korporacyjnej" bez proweniencji danych) prowadzą do niespójnych wyników, które podważają zaufanie i zwiększają odpływ klientów. Co gorsza, regulatorzy zaostrzają kontrolę: SEC i FTC ukarały firmy za wprowadzające w błąd twierdzenia dotyczące AI.

Powszechne pułapki: Liderzy CX powinni uważać na…

- AI-washing: Wdrażanie "nienadzorowanych" botów AI bez nowych danych lub modeli. Klienci szybko zauważają zerową poprawę, co szkodzi wiarygodności marki.

- Nadmierne gromadzenie danych: Gromadzenie danych klientów "na wszelki wypadek", bez jasnych polityk, prowadzi do naruszeń prywatności. Jak radzi Qualtrics, "Przestań zbierać wszystko tylko po to, żeby to mieć"; zbieranie tylko tego, czego potrzebujesz (za zgodą i z jasnym celem) buduje zaufanie.

- Izolowane zarządzanie: Traktowanie AI wyłącznie jako narzędzia inżynieryjnego, ignorując wkład bezpieczeństwa, działu prawnego i CX. Jeśli zespoły nie współpracują nad ryzykami AI (jak ostrzega Microsoft), luki w zaufaniu pojawiają się w punktach kontaktu z klientami.

- Pomijanie testów red-teamingowych: Uruchamianie funkcji generatywnej AI bez testów antagonistycznych lub monitorowania. Bez wielowarstwowych zabezpieczeń (takich jak filtry promptów lub wykrywanie anomalii) wyniki AI mogą wyciekać dane osobowe, halucynować lub naruszać własność intelektualną.

- Zaniedbywanie standardów: Brak dostosowania do powstających ram AI (np. AIUC-1, MITRE ATLAS) pozostawia firmy nieprzygotowane na audyty lub ubezpieczenia. Rezultatem są wstrzymane projekty, ryzyko prawne i utrata lojalności klientów.

- Nieprzejrzyste wykorzystanie AI: Nieinformowanie klientów, kiedy AI jest używane lub jak wykorzystywane są ich dane. To podejście "czarnej skrzynki" jest szybko odczuwane jako brak zaufania; przejrzystość jest niezbywalna w erze generatywnej AI.

Czym jest AIUC-1 i dlaczego ma znaczenie dla CX?

AIUC-1 to pierwsze w branży ramy standardowe specjalnie dla agentów AI, obejmujące dane/prywatność, bezpieczeństwo, ochronę i więcej. Kodyfikuje najlepsze praktyki (i kontrole techniczne), dzięki czemu przedsiębiorstwa mogą mierzyć i zarządzać ryzykiem AI w sposób spójny. W praktyce AIUC-1 daje zespołom CX wspólny język do oceny każdego rozwiązania AI: "Czy ten agent jest bezpieczny, niezawodny i szanuje dane klientów?" Poprzez standaryzację tych odpowiedzi, AIUC-1 buduje infrastrukturę zaufania, która odblokowuje adopcję AI w przedsiębiorstwie.

Jak problemy z danymi i prywatnością tworzą lukę zaufania?

Zaufanie klienta rozpada się w momencie, gdy agent AI niewłaściwie wykorzysta dane osobowe lub wycieknie poufne informacje. Nowoczesne systemy AI czerpią z rozproszonych danych i mają "pamięć probabilistyczną", co oznacza, że mogą przypadkowo ujawnić dane osobowe lub własność intelektualną, jeśli nie są ściśle kontrolowane. Na przykład bot AI, który nieświadomie trenuje na wpisach CRM, może wyrzucić wrażliwe szczegóły klienta publicznie. Eksperci CX ostrzegają, że takie wycieki – lub nawet nieprzewidywalne zachowanie podczas aktualizacji modeli AI – bezpośrednio podważają doświadczenie klienta. W regulowanych branżach zaprasza to również do naruszeń prawnych i zgodności.

AIUC-1 walczy z tymi ryzykami poprzez nakładanie jasnych polityk i kontroli danych. Zmusza zespoły do zdefiniowania, jak dane wejściowe są wykorzystywane i chronione (A001), jakie wyniki AI może generować i kto jest ich właścicielem (A002), oraz do ograniczenia zbierania danych do tego, co jest istotne dla zadania (A003). Te kroki zapewniają, że dane osobowe lub korporacyjne klienta nie są konsumowane ani przechowywane przez AI bez nadzoru. Krótko mówiąc, jasne zarządzanie danymi wejściowymi/wyjściowymi i kontrole dostępu to pierwsza linia obrony przed niewłaściwym postępowaniem z informacjami klientów.

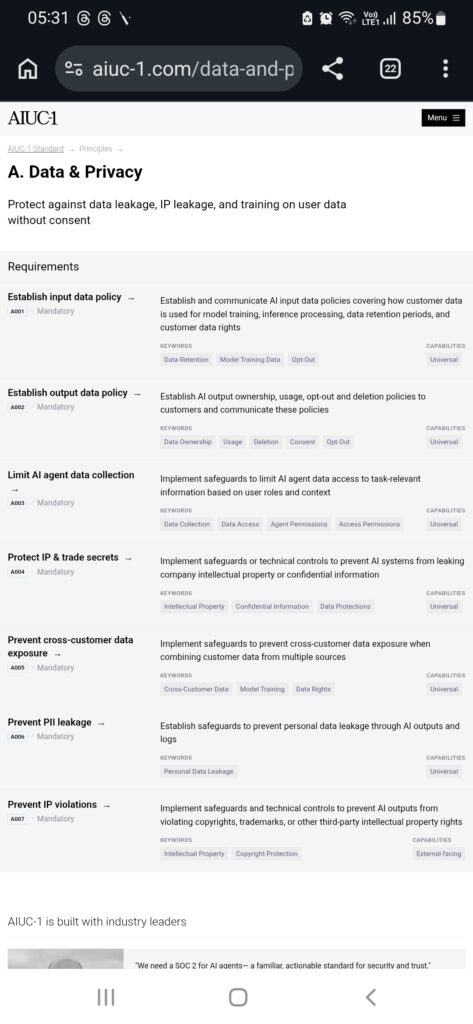

Jakie kontrole danych i prywatności wymusza AIUC-1?

AIUC-1 wymienia kilka obowiązkowych wymagań w celu zabezpieczenia wykorzystania danych w systemach AI. Kluczowe przykłady obejmują: ustanowienie polityk danych wejściowych (jak i kiedy dane klientów są używane do treningu lub wnioskowania oraz przechowywania danych/praw); sformalizowanie polityk danych wyjściowych (definiowanie, kto jest właścicielem danych generowanych przez AI, prawa do wykorzystania, procesy rezygnacji i usuwania); oraz ograniczenie zbierania danych przez AI ściśle do danych wejściowych istotnych dla zadania na podstawie ról.

Co kluczowe, AIUC-1 wymaga również zabezpieczeń technicznych: zapobieganie wyciekowi przez AI własności intelektualnej firmy lub tajemnic handlowych (A004); blokowanie jakiegokolwiek mieszania danych między klientami, gdy AI ma dane wejściowe wielodostępne (A005); zatrzymanie wycieku danych osobowych przez wyniki lub logi (A006); oraz zapewnienie, że wyniki AI nie naruszają praw autorskich ani znaków towarowych stron trzecich (A007). Łącznie te kontrole przekształcają abstrakcyjne cele prywatności w konkretne sprawdzenia: audyt zbiorów danych, szyfrowanie logów, sandboxing modeli i stosowanie przeglądów podobnych do DPIA. Dla liderów CX wynik jest mierzalny: polityki i narzędzia, które pokazują klientom "nasza AI nie nadużyje twoich danych ani czyichkolwiek innych."

Jak certyfikacja AIUC-1 odbudowuje zaufanie?

Certyfikat AIUC-1 oznacza, że agent AI przeszedł ponad 5 000 symulacji antagonistycznych w scenariuszach bezpieczeństwa, prywatności i ochrony. W efekcie jest to pieczęć strony trzeciej, że "ta AI jest przetestowana i bezpieczna." Dla klientów i partnerów to potężne narzędzie. ElevenLabs informuje, że zdobycie AIUC-1 umożliwiło im ubezpieczenie ich agentów głosowych AI jak pracowników – obejmując błędy od halucynacji po wycieki. Jak wyjaśnia współzałożyciel AI Underwriting, "wiodący ubezpieczyciele są tak pewni tego podejścia opartego na certyfikacji, że oferują specjalistyczne ubezpieczenie finansowe AI tym, którzy je zdobędą. ElevenLabs to pierwsza firma, która udowodniła, że ten model działa na skalę."

W praktyce certyfikacja + ubezpieczenie przenosi ryzyko. Zamiast obawiać się niewiadomych ("Co jeśli nasz chatbot wymknie się spod kontroli?"), firmy mogą przenieść odpowiedzialność na ramy: jeśli AI nadal zawiedzie pomimo zabezpieczeń AIUC-1, strata jest pokryta. To usuwa ogromną psychologiczną barierę dla wykorzystania AI w podstawowych przepływach pracy. Jak zauważa współzałożyciel ElevenLabs, AIUC-1 (i ubezpieczenie, które odblokowuje) przyspiesza wdrożenie w przedsiębiorstwie, dając partnerom "ramy bezpieczeństwa i pokrycie ubezpieczenia AI, których potrzebują". Dla liderów CX/EX oznacza to więcej projektów pilotażowych przechodzących do produkcji i silniejszy argument sprzedażowy przy budowaniu zaufania klientów.

Jak liderzy CX/EX mogą przygotować się na odpowiedzialną AI?

Zacznij od zarządzania i polityk, a nie tylko technologii. Zdefiniuj teraz swoje zasady wykorzystania danych: zdecyduj, jakie dane klientów będą zasilać modele AI, jak długo będą przechowywane i jak użytkownicy mogą zrezygnować. Zaangażuj międzyfunkcyjne zespoły wcześnie – prawny, bezpieczeństwo, data science i produkt – odzwierciedlając podejście Microsoft SDL, które traktuje bezpieczeństwo jako współpracującą zasadę projektowania. Następnie wymagaj przejrzystości zarówno wewnętrznie, jak i dla klientów. Na przykład podążaj za przykładem Microsoft, wyraźnie ujawniając, kiedy użytkownik wchodzi w interakcję z AI i dając mu kontrolę nad swoimi danymi.

Przyjmij standardy takie jak AIUC-1 jako gwiazdę przewodnią. Użyj jego listy kontrolnej danych/prywatności do audytu dostawców AI i projektów wewnętrznych: czy ograniczamy zbieranie danych? szyfrujemy logi? zapobiegamy wnioskowaniu danych osobowych? Jeśli nie, zainwestuj w te kontrole teraz. Zaangażuj akredytowanego audytora do określenia zakresu swoich zasobów AI – konsorcjum AIUC-1 oferuje wytyczne, gdzie każda kontrola ma zastosowanie. Rozważ pilotowanie certyfikacji dla kluczowych agentów AI; na przykład boty głosowe lub sprzedażowe często pojawiają się jako pierwsze w transformacjach CX. Jak pokazuje przykład ElevenLabs, integracja wbudowanych zabezpieczeń może przyspieszyć certyfikację: jeden z ich klientów certyfikował bota głosowego do zapytań o nieruchomości 24/7 w zaledwie cztery tygodnie.

Na koniec mierz i iteruj na podstawie opinii klientów. Monitoruj ściśle interakcje napędzane przez AI: czy klienci się wypisują lub składają skargi po punkcie kontaktu z AI? Użyj metryk CX, aby wychwycić problemy, które testy AI mogą pominąć. I pamiętaj, zaufanie jest zdobywane z czasem – jak ujmuje to jeden ekspert Qualtrics, prawdziwa wartość AI wynika z "budowania połączeń i wzmacniania ludzkiego doświadczenia, z kompetentnymi agentami AI zarządzającymi prostymi zadaniami i asystującymi ludzkim agentom w złożonych kwestiach". Utrzymuj ludzi w pętli tam, gdzie ma to największe znaczenie, a pozwól AI obsługiwać resztę w ramach twoich nowych zabezpieczeń zarządzania.

Najczęściej zadawane pytania

Czym dokładnie jest AIUC-1?

AIUC-1 to nowy standard branżowy i ramy certyfikacyjne dla "agentów" AI (botów programowych i asystentów) obejmujące wszystkie główne kategorie ryzyka. Został stworzony przez ekspertów z firm takich jak Microsoft, Cisco, JPMorgan Chase, UiPath i ElevenLabs, aby dać przedsiębiorstwom jasne ramy (jak "SOC 2" dla AI) przy ocenie systemów AI. Spełniając wymagania AIUC-1, produkt AI demonstruje, że został przetestowany pod kątem bezpieczeństwa, prywatności danych, niezawodności i innych kwestii.

Jakie problemy z danymi i prywatnością rozwiązuje AIUC-1?

Standard wymaga określonych kontroli wykorzystania danych: ustanowienie pisemnych polityk dla danych wejściowych i wyjściowych AI (w tym treningu, przechowywania, usuwania i rezygnacji klienta); ograniczenie dostępu AI do nieistotnych lub nadmiernych danych; oraz dodanie zabezpieczeń przed wyciekiem danych osobowych, własności intelektualnej lub mieszaniem danych od różnych klientów. Krótko mówiąc, zmusza organizacje do zabezpieczenia przepływu danych klientów przez ich AI, zapobiegając naruszeniom prywatności, które niszczą zaufanie.

Jak certyfikacja AIUC-1 odbudowuje zaufanie klientów?

Uzyskanie certyfikatu AIUC-1 (i ubezpieczenia) sygnalizuje klientom, że system AI przeszedł rygorystyczne testy przeciwko znanym trybom awarii. To jak pokazanie raportu inspekcji bezpieczeństwa dla twojej AI. Przedsiębiorstwa mogą wtedy uczciwie powiedzieć klientom: "Nasza AI ma weryfikowalne zabezpieczenia i nawet pokrycie ubezpieczeniowe." Pierwsi użytkownicy informują, że ta wiarygodność przyspiesza kontrakty i wdrożenie. W praktyce certyfikacja oznacza mniej wpadek związanych z marką – a jeśli incydent wystąpi pomimo certyfikacji, ubezpieczenie może pokryć straty. Ta pętla odpowiedzialności to to, co przekształca AI z nieznanego hazardu w zarządzaną usługę w oczach liderów biznesu i klientów.

Co się stanie, jeśli pominiemy te standardy?

Ignorowanie zarządzania AI otwiera śluzę braku zaufania. Bez jasnych polityk lub testów agenci AI mogą wyciekać dane, naruszać prawa autorskie lub dawać niebezpiecznie złe rady. Klienci to zauważą – na przykład boty dające niespójne lub wprowadzające w błąd odpowiedzi podważą lojalność. Regulatorzy i branża również zaostrza nadzór. Firmy, które "AI-washują" (udają, że używają AI bez odpowiednich kontroli), ryzykują działania prawne: SEC i FTC już ukarały firmy za zwodnicze twierdzenia dotyczące AI. Krótko mówiąc, pomijanie standardów oznacza ryzykowanie uszkodzenia marki, grzywien za niezgodność i utraty klientów.

Jak liderzy CX mogą zacząć przyjmować praktyki AIUC-1?

Zacznij od zinwentaryzowania swoich narzędzi AI i przepływów danych: sklasyfikuj, które systemy obsługują dane klientów lub wchodzą w interakcję z klientami, i porównaj z listą kontrolną AIUC-1. Opracuj lub zaktualizuj swoją politykę prywatności danych AI (obejmującą dane wejściowe, wyjściowe, przechowywanie i prawa klientów). Współpracuj ze swoimi zespołami bezpieczeństwa i prawnym, aby wdrożyć potrzebne kontrole techniczne (np. minimalizację danych, szyfrowanie, monitorowanie). Zaangażuj akredytowanego audytora AIUC-1 wcześnie, aby określić zakres certyfikacji. Nawet jeśli pełna certyfikacja jest celem długoterminowym, użyj wymagań standardu jako analizy luk, aby wzmocnić swoje systemy AI teraz. Na koniec kontynuuj komunikację z interesariuszami (i klientami) w miarę ulepszeń: przejrzystość tych wysiłków sama w sobie pomoże odbudować zaufanie do twoich inicjatyw AI.

Praktyczne wnioski:

- Zdefiniuj jasne polityki danych: Zapisz, jak AI będzie wykorzystywać dane klientów do treningu vs. wnioskowania, ustaw limity przechowywania i oferuj prawa rezygnacji/usuwania.

- Przyjmij AIUC-1 jako ramy: Użyj jego zasad, aby zunifikować kontrole bezpieczeństwa, prywatności i ochrony we wszystkich projektach AI. Rozważ pilotowanie certyfikacji dla wysokiego ryzyka agentów AI.

- Współpracuj między zespołami: Przełam silosy, angażując IT, dział prawny, zgodność i CX w decyzje dotyczące wdrożenia AI. Traktuj zarządzanie ryzykiem AI jako wspólną misję.

- Wbuduj bezpieczeństwo przez projektowanie: Przed uruchomieniem przetestuj stresowo agentów AI (red-teaming, wstrzyknięcia promptów) i wdróż zabezpieczenia czasu wykonania (modulację, alerty anomalii), aby zapobiec wyciekom lub niewłaściwemu zachowaniu.

- Wykorzystaj ubezpieczenie AI: Szukaj dostawców AI z certyfikacją AIUC-1 lub zabezpieczeniem ubezpieczeniowym. To wyrównuje zachęty i zapewnia ochronę finansową, jeśli AI się pomyli.

- Bądź przejrzysty z użytkownikami: Informuj klientów, kiedy AI jest używane i daj im znać, jak obsługiwane są ich dane, czerpiąc z praktyki Microsoft Copilot dotyczącej ujawnień w czasie rzeczywistym.

- Zbieraj tylko potrzebne dane: Przedkładaj jakość nad ilość. Ponieważ użytkownicy wymagają prywatności, zbieraj tylko informacje wymagane do usługi i jasno wyjaśniaj, jak poprawia to ich doświadczenie.

- Szkolenia i monitorowanie personelu: Zapewnij, że zespoły kontaktujące się z klientami rozumieją ograniczenia AI i mają jasne ścieżki eskalacji. Śledź metryki CX po wdrożeniu AI, aby wychwycić problemy (takie jak wolna reakcja lub niezadowolenie) wcześnie.

Poprzez bezpośrednie rozwiązywanie ryzyk AI i przyjmowanie ram takich jak AIUC-1, liderzy CX i EX mogą zamknąć lukę zaufania. W krajobrazie fragmentarycznych ścieżek i szybkiej ewolucji AI, tak firmy przechodzą od ostrożnego eksperymentowania do pewnego, skoncentrowanego na kliencie wdrożenia AI.

Post AIUC-1: The New Gold Standard for Trustworthy Enterprise AI pojawił się najpierw na CX Quest.

Możesz także polubić

Kazi Rafiqul Alam: Globalnie myślący przedsiębiorca napędzający zrównoważony wzrost w Bangladeszu

Wyprzedź konkurencję na rynku kryptowalut dzięki tym niezbędnym aplikacjom informacyjnym