Почему музыка ИИ человеческая и новая без нового?

Революция свершилась: для большинства музыка, созданная ИИ, уже неотличима от "живой". ИИ-артисты подписывают контракты, NARAS (организаторы "Грэмми") не против использования ИИ, а лидеры рынка — Suno/Udio — играют по правилам больших дядей. Наверное, можно закончить споры, но нет: одни настаивают на "отсутствии души", другие — на ложном векторе развития музыкального ИИ. Мне кажется, есть способ прояснить ситуацию, обратившись к самой природе музыки.

Что такое музыка? Выразительные средства

Из всех определений мне ближе формальное: "Музыка — это звуки, организованные человеком во времени и пространстве".

Организация звуков в музыкальный образ, передающий эмоцию, осуществляется с помощью выразительных средств (ВС). Западноевропейская теория музыки (ЗЕТМ) относит к ним мелодию, гармонию, ритм и пр. Однако она плохо подходит для анализа рока, джаза, электронной музыки, фольклора. Лучше опираться на психоакустику (синтез физики и психологии) и выделять такие компоненты:

-

Звуковысотные — изменения частоты основного тона, комбинаций тонов (интервалы, лад, кривая Pitch...);

-

Громкостные — изменения амплитуды (громкость, акценты, огибающая отдельного звука, фразы, периода, амплитудная модуляция...);

-

Ритмические — временны́е параметры (длительность звука, паузы, ритмические фигуры, темп и его вариации);

-

Тембровые — изменения спектра (частотные составляющие, их периодические и непериодические изменения...);

-

Пространственные — касающиеся среды и позиционирования звуков (влево/вправо, ближе/дальше, выше/ниже, отражение/поглощение...).

Музыкальный элемент (мелодия, аккорд и пр.) и произведение в целом — это комбинация этих компонентов. В разных культурах и жанрах наборы ВС варьируются (по сути, это разные "музыкальные языки"). Иногда какой-то компонент вовсе может отсутствовать.

Представитель ЗЕТМ не поймёт музыкальный язык африканца, исполняющего только на барабане (без пения) песни: свадебную, похоронную, боевую, сборки урожая, молитвы о дожде. Говоря грубо: "Где музыка, если рояля, виолончели, тоники, доминанты, мажора/минора — т.е. ничего нет?". Да и пьесу на хомусе в рамках этой теории не описать. Даже рок-музыку классики не считали новой из-за сходства мелодий и гармоний, хотя в исполнительских приёмах (штрихах) и тембрах появилось очень много нового.

Поиски новизны: от классики к экспериментам

Впрочем, в начале XX века и классики почувствовали узость ЗЕТМ. Отсюда поиски новых тембров — "подготовленное фортепиано" (помещение монет между струн), интерес к электронным инструментам — Терменвокс и др. Композиторам не хватало свободы и в классической гармонии, и в мелодике, как следствие — обращение к алеаторике (случайному) и неестественному: "брызги чернил на нотную бумагу", использование математических теорий в композиции (К.Штокхаузен, Дж.Кейдж, Я.Ксенакис).

Всё это, по сути, отказ от естественного, определяемого музыкальной акустикой и психологией восприятия. Но это было свежо и, главное, выразительно! Почему? Чудо происходило в момент исполнения. Человек не может произнести фразу абсолютно невыразительно, музыканты не могут сыграть абстрактные ноты без исполнительских приёмов. Когда-то я давал задания студентам консерватории — набор случайных нот, без размера, темпа, тактовых черт. И все они исполняли этот бред весьма выразительно: определяли фразы, расставляли акценты и пр. Это делали как духовики, вокалисты, так и скрипачи, пианисты, которым не нужно брать дыхание.

Что делает музыку музыкой?

Главное в музыке — исполнитель, оперирующий ВС. Ключевое слово — "оперирующий". Если дать музыканту инструмент, воспроизводящий "самый совершенный звук во вселенной" одним нажатием кнопки, он не будет доволен. Где исполнение-то? Ему нужно влиять на звук: изменять этот единственный или извлекать серию (хотя бы по пентатонике).

Новое в музыке, то, что определяет её развитие — это изменение набора выразительных средств: кто-то ввёл в обиход новый аккорд, кто-то мелодический оборот, кто-то тембр/инструмент, кто-то приём/штрих, кто-то ритм и т.п.

Каждый слышит что-то своё. Примеры

Как уже отмечал, большую роль в точности распознавания звуковых образов играют дифференциальные пороги восприятия, а развитие музыкального ИИ подсказывает пути для обновления теории слуха.

1] Композитор на симфоническом концерте различает едва заметную флейту, исполняющую второстепенную партию, — и даже "слышит" ноты, которых нет, потому что они должны там быть. Охотник в лесу видит птицу, недоступную нетренированному глазу. Поменяем их местами: охотник спросит: "А как она звучит?", композитор скажет: "Тут вообще никого нет".

2] Работая над аранжировками для фильма с индийскими музыкантами (теми, кто ещё не полностью перешёл на западные шаблоны), я отметил три момента:

-

Резкая смена настроения/ эмоции в рамках одной песни. Мы как-то определённее: либо печаль, либо радость.

-

Нетипичная для нас форма: припев → куплет → проигрыш и всё снова, плюс обязательная 3-я часть. Я её называл "Мораль", "Вывод" — в ней и текст, и мелодия несли явное наставление.

-

Игнорирование правил гармонизации ЗЕТМ: любой аккорд можно влепить, не обращая внимания на то, что было до и что будет после.

Вывод: если у них другой набор ВС (иной музыкальный язык) — у них другое слышание.

3] Смотрю видео, как (условно) шведы, ирландцы слушают народную песню со слезами на глазах — вероятно, её пели им в детстве. Для меня же в ней "ничего нет": музыка не трогает, эмоция не передаётся.

4] Нажал взрослый человек кнопку дверного звонка, мелодия ... и вдруг из памяти всплывают картины первой любви. Звук отвратительный, но воспоминания оживают, и в голове звучит та самая песня... К слову, хороший музыкант "слышит" музыку, глядя даже в незнакомую партитуру.

5] Эпизод из 90-х: московские музыканты в новосибирском ресторане, услышав игру ансамбля, подошли к сцене: "Откуда этот звук, что за аппарат? В этом Roland'е нет такого тембра!"... За клавишами был Сергей Кокорин (ныне худрук Биг-бенда Сочи). Он на слух "разбирал" новый звук на элементы, "вычислял" его "формулу" и точно настраивал 30 параметров синтезатора для имитации.

Итак, мы все слышим разное, у каждого своя "звуковая картина". И в большинстве случаев дело не в анатомии. Это результат тренировки, т.е. работа мозга: мы "дослышиваем" (дорисовываем картину) на основе нашего прежнего опыта, даже когда получаем не всю информацию.

Сила и слабость музыкального ИИ

Генерация музыки давно интересует человека. До появления ИИ всё основывалось на формализации правил — как музыка устроена и как её исполняет музыкант. Если с партитурами многое было очевидным, то с исполнительскими нюансами (т.е. с тем, что и делает музыку живой) всё оказалось намного сложнее. Для отладки алгоритмов генерации можно взять всё формализованное из учебников ЗЕТМ, курсов джазовой импровизации, уроков по электронной музыке, но результат, по большому счёту, так и не станет "человеческим". Свидетельство этому — аппараты и программы автоаккомпанемента (так называемые "самоиграйки", даже самые дорогие) и то, что без участия человека Vocaloid и его аналоги живой вокал не выдают. Причина в сложности имитации ВС, которые в ЗЕТМ на втором плане: тембр, его вариации, штрихи, тонкие изменения Pitch — т.е. всё то, что важно для выразительности, но в традиционной партитуре не представлено.

Как отразить в нотах, что гитарист щипнул две струны — 1-ю и 2-ю, зажатые с "разбегом" в 4 лада (1 полутон) и подтянул 2-ю до 1-й, в унисон (эффектнее с Distortion/Overdrive) или что клавишник "поиграл" Pitch Wheel во время соло? Таких приёмов сотни, и их звучание зависит от множества факторов: марки инструмента/комбика, пресета, положения регуляторов и так далее. Приблизиться к образцу можно лишь экспериментируя, анализируя аудио и видео. Т.е. формальных правил, которые можно запрограммировать и использовать в генерации, нет. По сути, у классической музыки в целом есть "письменность", а у современной (с необходимой детализацией) — отсутствует. При этом обучение и традиционных музыкантов строится в основном на повторении ("делай, как я"), а не на чтении партитур.

Долой правила!

А вот в генерации музыки с ИИ через спектр (Suno, Udio, Riffusion, Sonauto, Mureka...) вся эта формализация не требуется. Если раньше в электронном инструменте, программе добавлялась какая-то автоматика для оживления, то инженер, музыкант точно знал, зачем та или иная операция. Теперь с ИИ все правила остаются "за скобками", в неявном виде — точнее, в "чёрном ящике". Анализ исполнительских нюансов, ВС вообще не требуется: правила работают, но их никто не видел! Вы обучаете систему на нескольких образцах, затем она создаёт новый спектр (новое "полотно"), в котором все штрихи соответствуют тому, чему её научили. Всё как в живописи: скормили ИИ 30 картин Айвазовского — на выходе новые картины с соблюдением всех характерных признаков художника...

Хотя 90% музыки слушается в наушниках, кафе, автомобиле, ТЦ, а не на Hi-End системах, придирки по качеству два года назад понятны. Смотреть надо на ноты и на штрихи — а они все верные. Поначалу (т.к. сам занимался генерацией) меня это сильно удивляло. Думал, может, я чего-то не слышу. Обратился к профессиональным музыкантам — они подтвердили, что все ноты, нюансы — всё правильно.

Исключение формализации музыкального исполнения при генерации — невероятный, революционный прорыв. При этом:

-

До появления ИИ человек мог управлять любым параметром генерации, но система не воспроизводила выразительные компоненты достаточно натурально.

-

Теперь с ИИ у нас нет доступа к параметрам генерации в явном виде, но система воссоздаёт выразительные элементы на уровне лучших человеческих образцов.

О "душе" в генерациях ИИ

Всё определяется восприятием слушателя. Кто сказал, что все живые исполнители поют, играют "с душой", искренне любя и уважая аудиторию? Надо хотя бы раз побывать за сценой, чтобы усомниться в этом. Артист, в совершенстве владеющий ВС, способен заставить зал плакать, сопереживать, обретать уверенность или смеяться. При этом он нередко пренебрежительно относится к своим поклонникам. Нужно быть очень высоконравственным человеком, чтобы не поддаться соблазну считать себя выше публики, когда она смотрит на тебя с обожанием.

Более того, владение в совершенстве исполнительским искусством порой позволяет обойтись без "собственного лица". Одно время я работал с вокалистом, который безупречно имитировал Я.Гилана, П.Маккартни, В.Леонтьева, В.Мулявина, но не знал, как спеть "по-своему" песню, которую ещё никто не исполнял.

ИИ-генераторы разные. Критерии оценки

На мой взгляд, генерации Suno, Udio, Sonauto весьма "живые и человеческие", особенно с акустическими соло (гитара, смычковые, духовые). Они на порядок натуральнее всего, что создавалось аппаратами до эпохи ИИ.

Исключение составляют системы, обученные не на спектрах, а на MIDI-файлах (электронных партитурах): AIVA, Boomy, Loudly, Media.io, Melobytes, Mubert и др. Эти ИИ-генераторы не воспроизводят исполнительские нюансы — они отсутствуют в датасете. Во многих из них даже нельзя задать такие стили, как Bossa-nova, Acoustic guitar solo. Похоже, система просто создаёт новый MIDI-файл, который затем озвучивается семплами. Для электронной или фоновой музыки этого порой достаточно, правда, и вокальные треки в таких генераторах обычно не предусмотрены.

Кажется несправедливым сравнивать каждый сгенерированный трек с мировыми шедеврами, составляющими тысячные доли процента от того, что создают люди. В музыкальном плане (гармония, мелодика, аранжировка, детализация) генерации лидеров рынка превышают средний профессиональный уровень. Закажите аранжировку песни в обычной студии за 30-100 т.р. — скорее всего, музыка эта будет слабее, чем у Suno. Послушайте саундтреки наших типичных сериалов — зачастую они тоже уступают генерациям (если только это не лицензированные мировые хиты). И ведь это работа профессионалов. А если вам потребуется "серьёзный" стиль — симфонический оркестр, биг-бенд — где вы это будете заказывать?

Почему в генерациях нет нового?

Новации в музыке — это новый набор выразительных средств, а генерации строятся из того, что было найдено и отработано людьми ранее. Генеративный ИИ на данном этапе действует по принципу: "слепила из того, что было".

Конечно, что-то новое можно получить, смешивая стили — особенно близкие, "совместимые". Не все сочетания оказываются удачными. Например, попытка совместить лирический тенор (И. Козловский, Х. Каррерас) с Trash-metal не даёт осмысленного результата (я проверял). Да, сочетание русского текста с фонограммой и вокалом из трека Криса Ри — это новая песня. Но мы отчётливо понимаем, что получили вариацию того, что уже было.

Ограниченность числа вариаций

Если система использует модель, натренированную на одном треке (Audio Upload), и влияние других моделей сведено к минимуму (параметры Weirdness, Style/Audio influence), то "запас" вариаций достаточно быстро исчерпывается. На тестах в Suno это становится заметным примерно после 50 треков. С аналогичным эффектом столкнулся ещё в 2017 году при разработке собственного генератора: рендерить в одном стиле более 100 треков не имело смысла — всё становилось очень похожим. А если я задавал больше свободы в гармонии, не меняя стиль, то неизбежно снижалась стилевая точность.

О ложном векторе развития музыкального ИИ

Недавно довелось услышать предложение направить ИИ "по следам" человеческой мысли и науки, то есть, по сути, углубить ЗЕТМ и оцифровать всё возможное. Для гитариста это было бы созданием моделей струны, грифа, корпуса гитары, пальцев рук... А далее? Моделирование мозга или даже всего человека? Ведь нужно не только воспроизводить звуки, но и слышать, чувствовать...

Малая часть из этого списка давно реализована без привлечения ИИ: Physical Modeling Synthesize (VL серия у Yamaha, MOSS у Korg, COSM у Roland). Однако имитация щипковых, духовых на клавишах не стала легче — проще пригласить живого гитариста, саксофониста, чем извлечь что-то близкое к натуральному на этих высокотехнологичных аппаратах. Свидетельством этому служит BreathControl, позволяющий управлять синтезом посредством дыхания, подобно акустическому инструменту.

Я полагаю, что приверженцы классического инженерного подхода — с его упором на планирование, конструирование и контроль — быстро утратят энтузиазм, столкнувшись со сложностью формализации музыкального исполнения. (Я это понял при отладке алгоритмов, похожих на "обучение с учителем" для StyleEnhancer ещё 30 лет назад). В других областях (распознавание образов, обработка больших данных) инженеры уже осознали, что без ИИ эффективное решение задач невозможно. В конечном счёте ИИ — это попытка скопировать природу, где всё устроено разумно и экономично.

Что в будущем?

Думаю, всё смешается, произойдёт объединение подходов: использование ИИ музыкантами будет обыденным, как это случалось с другими инновациями в музыке. DAW нового типа, включающие все последние музыкальные ИИ-алгоритмы (вроде ACE Studio), станут стандартом. Учёные продолжат "укрощение" ИИ с целью сделать генерации более предсказуемыми.

Соревнование людей перейдёт на новый уровень. При этом, думаю, ИИ-детекторы и "анализаторы заимствований" — явление временное и даже вредное для музыкантов. Уверен на 100%: вскоре станет очевидно, что все друг у друга заимствуют — и делают это уже давно. Слышал историю (не могу подтвердить достоверность), что в СССР предпринималась попытка компьютерного анализа партитур на плагиат, но Союз композиторов был против, и проект свернули...

Гиганты музыкальной индустрии адаптируются к новым реалиям, поделят финансовые потоки и, как ранее, будут жить за счёт творчества и энтузиазма миллионов профессиональных музыкантов и любителей.

P.S. Данная статья — не научный отчёт. Многие утверждения звучат категорично — но лишь ради экономии места; в развёрнутом изложении объём был бы значительно больше. Если кому-то нужны более строгие формулировки (научные в понимании музыковеда), цитаты и ссылки по теме музыкального исполнения и выразительных средств с позиции психоакустики, вы найдёте их в статьях на моём сайте.

Описание экспериментов с музыкальным ИИ — в моём телеграм-канале.

Источник

Вам также может быть интересно

Этап 2 начинается: предпродажный аукцион ZKP Crypto входит в более конкурентную фазу, поскольку предложение токенов сокращается до 190 млн!

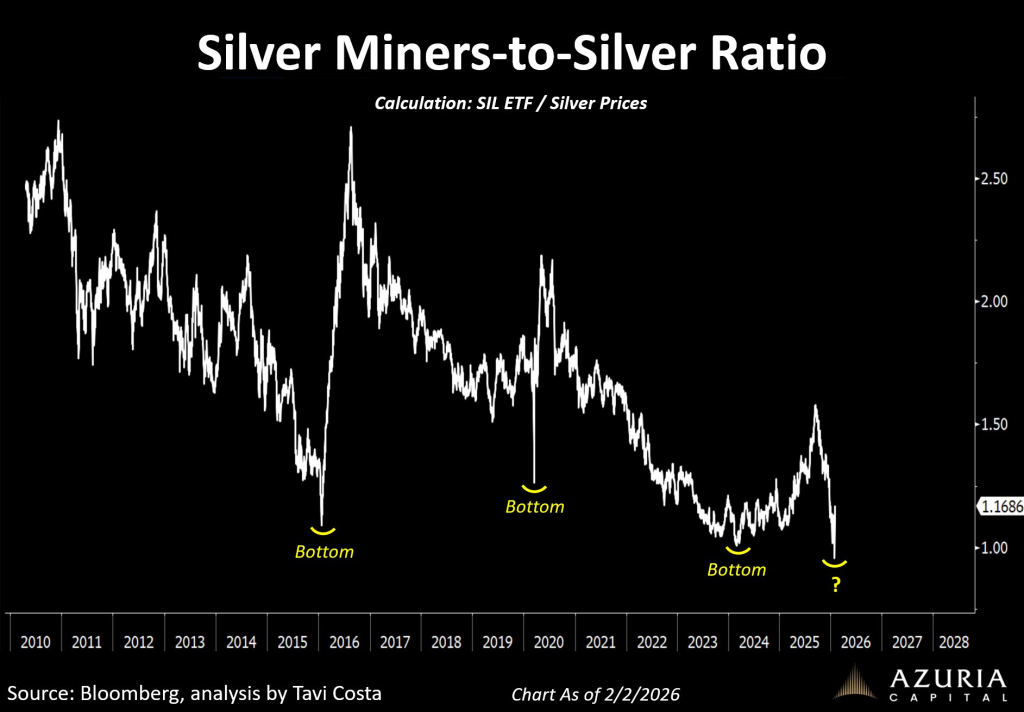

Майнеры серебра против серебра: это соотношение кричит о возможности