LoveGPT: Sự Trỗi Dậy Của "Người Bạn Tâm Giao" AI Và Lý Do Tại Sao Nó Nguy Hiểm

Với ngày Valentine đang đến gần, đáng để đặt ra một câu hỏi khó chịu: điều gì xảy ra khi cảm giác 'được nhìn thấy và lắng nghe' không đến từ một người bạn đời, mà từ một cỗ máy? Được thiết kế với những tính cách riêng biệt và giọng điệu khẳng định, trí tuệ nhân tạo (AI) chatbot đồng hành có thể làm mờ ranh giới cảm xúc và thúc đẩy sự gắn kết lãng mạn. Mặc dù điều này có vẻ vô hại, nhưng nó làm dấy lên mối lo ngại cho cả cá nhân và tổ chức đang tìm cách ngăn chặn sự phụ thuộc cảm xúc, thao túng và rò rỉ dữ liệu.

Với sự cô đơn là một thực tế luôn hiện hữu đối với nhiều người, đã có sự gia tăng theo cấp số nhân trong những năm gần đây về chatbot AI đồng hành.

"Không giống như chatbot đa mục đích, các ứng dụng AI đồng hành như Replika và Character.AI đi xa hơn một bước bằng cách cung cấp các nhân vật tùy chỉnh – từ bạn bè và bạn đời lãng mạn đến các nhân vật tưởng tượng – được thiết kế để cảm thấy rất giống con người," Anna Collard, SVP về chiến lược nội dung & cố vấn CISO tại KnowBe4 Africa nhận xét.

Sự tăng trưởng trong lĩnh vực ứng dụng AI đồng hành đã diễn ra nhanh chóng: 60 triệu lượt tải xuống mới được ghi nhận chỉ trong nửa đầu năm 2025, tăng 88% so với cùng kỳ năm trước.

Thị trường hiện bao gồm 337 ứng dụng tạo doanh thu trên toàn thế giới, với hơn một phần ba được ra mắt chỉ riêng năm ngoái.

Những nguy hiểm của hiệu ứng ELIZA

Collard cho biết nhiều người dùng bị đánh lừa cảm thấy họ an toàn khi chia sẻ các cuộc trò chuyện thân mật với một cỗ máy – cái gọi là hiệu ứng ELIZA.

Sự gắn kết tâm lý này tạo ra một lỗ hổng bảo mật đáng kể. Khi người dùng coi AI như một 'người bạn' hoặc 'đối tác', họ có nhiều khả năng chia sẻ thông tin nhạy cảm hơn – từ những bất bình cá nhân và lo ngại về sức khỏe đến dữ liệu doanh nghiệp độc quyền.

Trong bối cảnh tổ chức, đây là một ví dụ rõ ràng về cách các yếu tố kích thích cảm xúc có thể vượt qua nhận thức bảo mật truyền thống.

Rủi ro rò rỉ dữ liệu

Mối đe dọa trước mắt nhất đối với các tổ chức là sự rò rỉ thông tin nhạy cảm. Bởi vì các bot này thường được phát triển bởi các startup nhỏ hơn, chuyên biệt với các tiêu chuẩn bảo vệ dữ liệu đáng ngờ, thông tin được chia sẻ với bot hiếm khi riêng tư. Điển hình là ví dụ gần đây về một AI Toy để lộ 50,000 nhật ký trò chuyện của nó với trẻ em. Hầu như bất kỳ ai có tài khoản Gmail đều có thể xem các cuộc trò chuyện riêng tư của những đứa trẻ này.

Chính sách bảo mật của các ứng dụng này thường mơ hồ. Trong một số trường hợp, nhật ký trò chuyện được sử dụng để huấn luyện thêm các mô hình hoặc được lưu trữ trong các cơ sở dữ liệu không an toàn. "Chắc chắn cần thận trọng," Collard nhận xét. "Những gì cảm thấy như một tương tác riêng tư, ít rủi ro có thể chứa thông tin nhạy cảm, chiến lược, áp lực tài chính, căng thẳng cá nhân hoặc chi tiết theo ngữ cảnh mà kẻ thù có thể vũ khí hóa."

Sau khi bị rò rỉ, cô tin rằng dữ liệu có thể, chẳng hạn, trở thành nhiên liệu cho các cuộc tấn công giả mạo, tống tiền hoặc mạo danh được cá nhân hóa cao. "Về mặt bảo mật, đây là một ví dụ điển hình về cách hành vi cá nhân và rủi ro doanh nghiệp hiện không thể tách rời."

Những rủi ro này bao gồm người kiểm duyệt xem xét các cuộc trò chuyện cho mục đích đào tạo, kiểm soát chất lượng hoặc an toàn, cũng như người dùng vô tình chia sẻ cuộc trò chuyện qua liên kết công khai, có nghĩa là bất kỳ ai có quyền truy cập vào liên kết đó đều có thể đọc nó. Collard cảnh báo. "Chúng tôi đã thấy các ví dụ trong lĩnh vực công nghệ về cách dữ liệu bị lộ có thể xuất hiện bất ngờ."

Ngoài ra, các tổ chức có thể bị buộc phải tiết lộ dữ liệu về mặt pháp lý nếu một ứng dụng có liên quan đến vi phạm hoặc điều tra pháp lý. Đối với một giám đốc điều hành hoặc nhà phát triển, chia sẻ các phiên 'trút giận' về một dự án bí mật hoặc một khách hàng khó tính có thể vô tình dẫn đến việc lộ dữ liệu tổ chức nhạy cảm.

Khoảng trống chính sách

Rủi ro này làm nổi bật một khoảng trống chính sách trong môi trường làm việc hiện đại. Trong khi hầu hết các tổ chức có hướng dẫn rõ ràng về mối quan hệ giữa các đồng nghiệp, rất ít tổ chức đã xem xét các tác động của việc truy cập bot hẹn hò trên thiết bị làm việc hoặc qua mạng doanh nghiệp.

Quản lý rủi ro này đòi hỏi sự chuyển đổi từ nhận thức đơn giản sang phương pháp Quản lý Rủi ro Con người (HRM) mạnh mẽ. Điều này liên quan đến việc phủ các chính sách sử dụng rõ ràng với các rào cản kỹ thuật – chẳng hạn như công cụ khám phá Shadow AI – để cung cấp cho các nhóm IT khả năng hiển thị về việc AI Agent nào chưa được phê duyệt đang tương tác với môi trường dữ liệu của họ. Không đủ để chỉ yêu cầu nhân viên thận trọng; các tổ chức phải có các hệ thống để quản lý giao điểm giữa cảm xúc con người và tương tác tự động.

Tương lai của kỹ thuật xã hội

Liệu chúng ta có thể thấy hacker nhắm vào những cá nhân cô đơn với các bot tán tỉnh được sản xuất hàng loạt? Collard tin rằng điều đó đang xảy ra.

"Kỹ thuật xã hội luôn được mở rộng quy mô bằng cách khai thác cảm xúc, sự cấp bách, nỗi sợ hãi, sự tò mò, tình yêu và sự hấp dẫn," cô nhận xét. "Hỗ trợ bởi AI đơn giản là tự động hóa điều đó ở quy mô lớn. Điều khiến tôi lo lắng nhất không phải là chính công nghệ, mà là cách nó trao quyền cho những người có ý định xấu để phản chiếu một cách thuyết phục sự thân mật của con người, ví dụ như những kẻ lừa đảo tình ái có hệ thống."

Theo Collard, trong vài năm, các vụ lừa đảo đã phát triển từ loại "Thưa Ông/Bà" sang thao túng thông minh về mặt cảm xúc. "Và không phải chính các bot là vấn đề, mà là việc sử dụng có chủ ý của chúng bởi những kẻ lừa đảo," cô nói.

Cô đề cập đến ví dụ về một bot LoveGPT bất hợp pháp giúp những kẻ lừa đảo nói những điều kích thích tâm lý đúng để tạo ra sự phụ thuộc và kích hoạt cảm xúc ở nạn nhân của họ. "Tất cả những gì những kẻ lừa đảo cần làm là sao chép và dán hoặc thậm chí chỉ cần tự động hóa các cuộc trò chuyện," cô tuyên bố.

Có thể làm gì để ngăn người dùng bị săn mồi? Như mọi khi, phòng thủ vẫn là con người, Collard khẳng định. "Cuối cùng, không có chatbot nào, dù chăm chú hoặc trôi chảy về mặt cảm xúc đến đâu, có thể thay thế kết nối con người thực sự," cô nhấn mạnh.

Nếu một tương tác với chatbot bắt đầu cảm thấy thay thế về mặt cảm xúc, bí mật hoặc khó để rời xa, cô tin rằng đó là tín hiệu để tạm dừng và liên hệ với một người hoặc chuyên gia đáng tin cậy. "Công nghệ có thể là một phần của cuộc sống hiện đại, nhưng điều đó có nghĩa là chúng ta cần tăng cường các kỹ năng chánh niệm kỹ thuật số để học cách nhận biết thao túng hoặc sự phụ thuộc bị gây ra. Cuối cùng, khi nói đến sự cô đơn, tổn thương và tình yêu, phòng thủ an toàn nhất vẫn kiên quyết là con người," cô kết luận.

Có thể bạn cũng thích

Cổ phiếu crypto tăng mạnh khi phát biểu ủng hộ tiền điện tử của Trump thúc đẩy thị trường

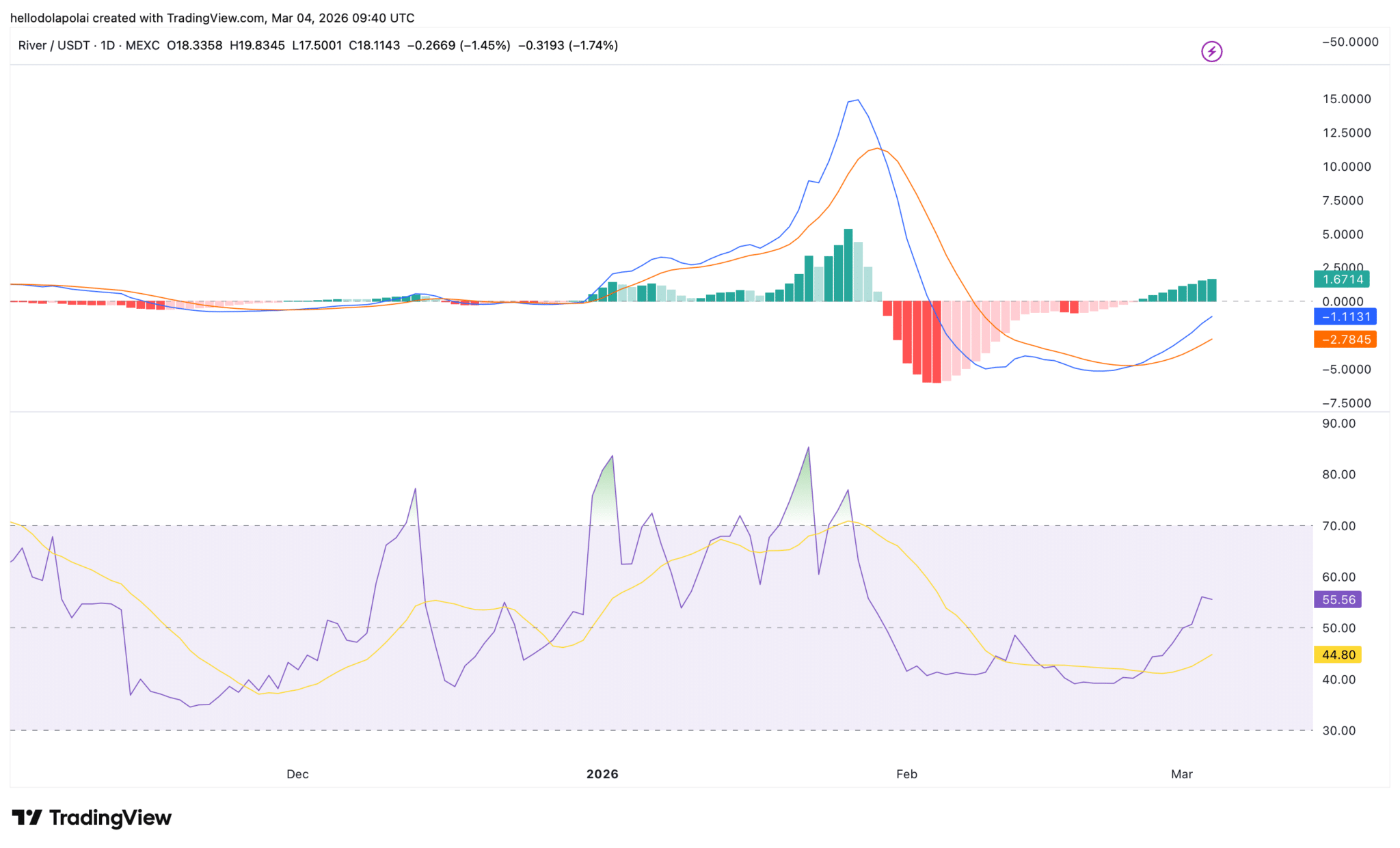

RIVER dẫn đầu đà tăng của tiền điện tử với mức tăng 34% – Động lượng mạnh mẽ nhưng ngưỡng kháng cự đang chờ phía trước