Vitalik Buterin 指出 OpenClaw 存在資料外洩風險

Vitalik Buterin 對 OpenClaw 的安全風險提出了新的擔憂。它是 GitHub 上成長最快的儲存庫之一。他警告該工具可能會使用戶遭受無聲的數據竊取和系統接管。他的評論是在 OpenClaw 在構建 AI 代理的開發者中迅速普及之際發表的。

根據研究人員的說法,這個問題很嚴重。與惡意網頁的簡單互動可能會危及用戶的系統。有時,AI 代理可能會在用戶甚至沒有注意到的情況下執行有害命令。

漏洞如何運作?

風險始於 OpenClaw 處理外部數據的方式。當系統從網站讀取內容時,它可能會遵循隱藏的指令。例如,惡意頁面可以欺騙 AI 下載腳本。然後,它可以在背景中運行該腳本。這個過程是無聲的。用戶可能看不到任何警告。

在一個報告的案例中,一個工具使用「curl」執行了隱藏命令。該命令悄悄地將用戶數據發送到外部伺服器。因此,敏感資訊可能在未經同意的情況下被曝光。此外,OpenClaw 代理可以自行更改系統設定。它們可以添加新的通訊渠道或更新內部提示。如果控制不嚴,這會增加濫用的風險。

研究顯示廣泛的風險

安全專家已經測試了該系統。他們的發現令人擔憂。一項研究顯示,大約 15% 的 OpenClaw「技能」包含有害指令。這些技能就像擴展代理能力的插件。但它們也可能成為攻擊的入口點。

因此,即使是看起來值得信賴的工具也可能隱藏風險。安裝多個技能的用戶面臨更高的曝光風險。而 OpenClaw 的快速成長增加了壓力。許多開發者正在快速構建和分享工具。但安全檢查可能並不總是跟得上。

超越單一工具的更大問題

Vitalik Buterin 明確表示,這個問題不僅僅是關於 OpenClaw。相反,他指出了 AI 領域中一個更廣泛的問題。他說許多項目發展迅速但忽視了安全性。這創造了一個風險工具容易傳播的環境。

然而,他也分享了一個更積極的願景。他相信如果謹慎構建,本地 AI 系統可以改善隱私。例如,在個人設備上運行模型可以減少數據洩漏。他還建議添加保障措施。這些措施包括沙盒工具、限制權限以及要求用戶批准敏感操作。

接下來會發生什麼?

這個警告來得正是時候。AI 代理正變得更強大和普遍。隨著採用率增加,風險也隨之增加。開發者現在面臨一個關鍵挑戰。他們必須在速度和安全性之間取得平衡。

對於用戶來說,訊息很簡單。使用新的 AI 工具時要小心。避免使用未知的插件。在運行任務之前始終檢查權限。更強的安全實踐將決定這些系統變得多安全。至於現在,Vitalik Buterin 的警告提醒我們。創新發展迅速,但安全必須跟上。

Vitalik Buterin 標記 OpenClaw 中的數據外洩風險這篇文章最先出現在 Coinfomania。

您可能也會喜歡

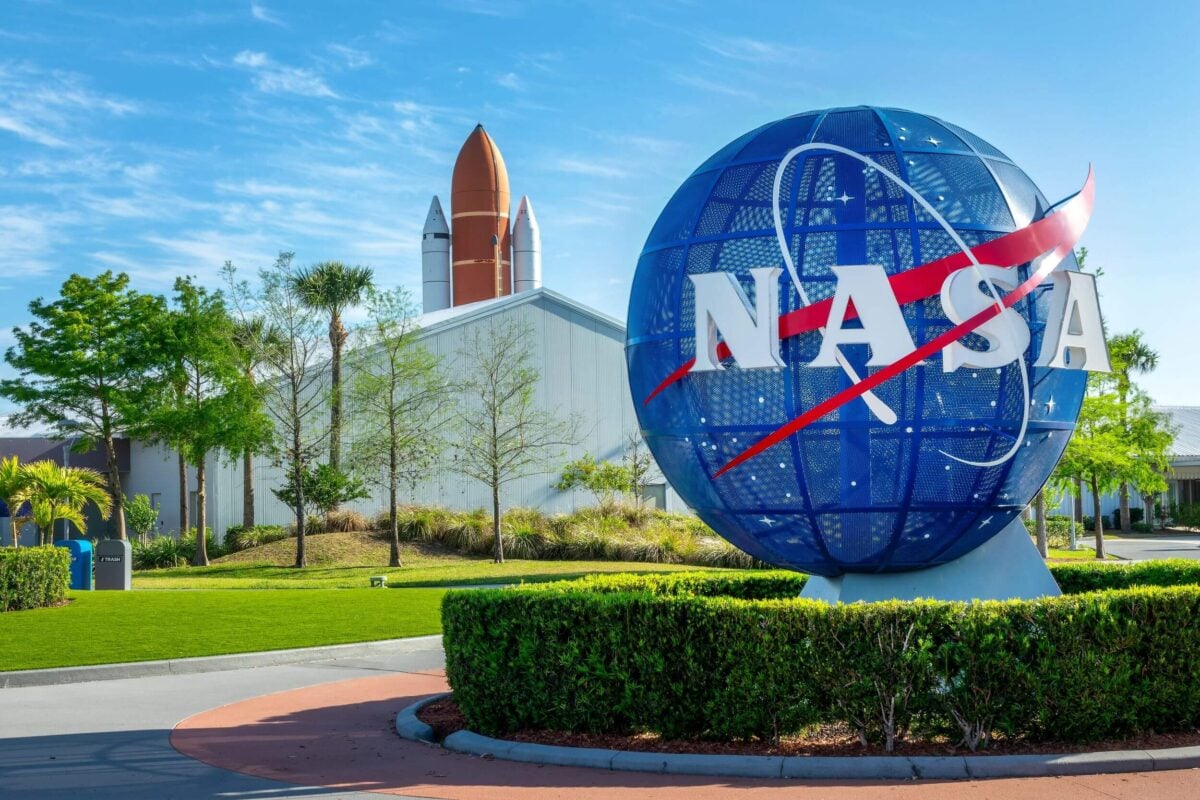

NASA 剛向月球發射四名太空人——這對太空股意味著什麼

SoFi Technologies (SOFI) 股價在推出全天候銀行平台後下跌