本文提出了一種新穎的決策邊界感知蒸餾方法,用於實例增量學習,無需訪問舊數據。本文提出了一種新穎的決策邊界感知蒸餾方法,用於實例增量學習,無需訪問舊數據。

醫學影像合成:用於 RUSS 和分割的 S-CycleGAN

連結表格

摘要和1 引言

-

相關工作

-

問題設定

-

方法論

4.1. 決策邊界感知蒸餾

4.2. 知識鞏固

-

實驗結果和5.1. 實驗設置

5.2. 與最先進方法的比較

5.3. 消融研究

-

結論和未來工作及參考文獻

\

補充材料

- IIL中KCEMA機制理論分析的詳細信息

- 演算法概述

- 數據集詳情

- 實現細節

- 灰塵輸入圖像的可視化

- 更多實驗結果

4. 方法論

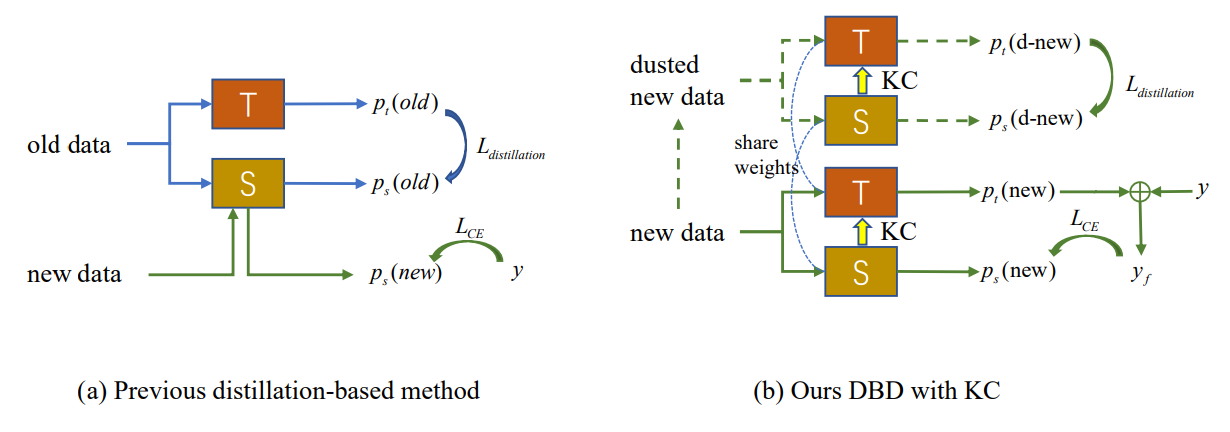

如圖2(a)所示,新觀察中概念漂移的出現導致了現有模型失敗的外部樣本的出現。新的IIL必須擴大決策邊界到這些外部樣本,同時避免在舊邊界上的災難性遺忘(CF)。傳統的基於知識蒸餾的方法依賴於一些保留的範例[22]或輔助數據[33, 34]來抵抗CF。然而,在提出的IIL設置中,除了新的觀察外,我們無法訪問任何舊數據。如果不向模型添加新參數,基於這些新觀察的蒸餾與學習新知識相衝突。為了在學習和不遺忘之間取得平衡,我們提出了一種不需要舊數據的決策邊界感知蒸餾方法。在學習過程中,學生學到的新知識會間歇性地鞏固回教師模型,這帶來了更好的泛化能力,是該領域的先驅嘗試。

\

\

:::info 作者:

(1) 聶強,香港科技大學(廣州);

(2) 傅偉富,騰訊優圖實驗室;

(3) 林宇歡,騰訊優圖實驗室;

(4) 李佳林,騰訊優圖實驗室;

(5) 周一峰,騰訊優圖實驗室;

(6) 劉勇,騰訊優圖實驗室;

(7) 聶強,香港科技大學(廣州);

(8) 王成傑,騰訊優圖實驗室。

:::

:::info 本論文可在arxiv上獲取,根據CC BY-NC-ND 4.0 Deed(署名-非商業性使用-禁止演繹4.0國際)許可證。

:::

\

免責聲明: 本網站轉載的文章均來源於公開平台,僅供參考。這些文章不代表 MEXC 的觀點或意見。所有版權歸原作者所有。如果您認為任何轉載文章侵犯了第三方權利,請聯絡 service@support.mexc.com 以便將其刪除。MEXC 不對轉載文章的及時性、準確性或完整性作出任何陳述或保證,並且不對基於此類內容所採取的任何行動或決定承擔責任。轉載材料僅供參考,不構成任何商業、金融、法律和/或稅務決策的建議、認可或依據。

您可能也會喜歡

Tangem Wallet 整合 Aave 提供穩定幣收益

Tangem Wallet 現在讓用戶可以在應用程式內獲得 USDT、USDC 和 DAI 的 Aave 收益,具有硬體安全性、簡單設置,且無需外部 DApps。Tangem 已

分享

Crypto.news2025/12/12 12:21

法官痛斥「卑鄙無恥」!昔日幣圈金童 Do Kwon 詐欺罪成立、遭判刑 15 年

昔日的幣圈金童,如今淪為階下囚。Terraform Labs 共同創辦人 Do Kwon(權道亨)12 月 11 日因涉及大規模詐欺案,遭美國法院重判 15 年有期徒刑。他所創立的 Terra 生態系在 2022 年 5 月崩盤,短短三天內就讓全球加密貨幣市場蒸發約 500 億美元,無數投資人血本無歸。 〈法官痛斥「卑

分享

Blockcast2025/12/12 12:17

桃園楊梅潮玩店推薦 結合盲盒與療癒系空間的小店

娛樂中心/綜合報導 疫情中誕生的桃園楊梅潮玩店 打造療癒系實體空間 2021 年,在疫情仍未趨緩、全球氛圍緊繃 […] 這篇文章 桃園楊梅潮玩店推薦 結合盲盒與療癒系空間的小店 最早出現於 民生頭條。

分享

Lifetoutiao2025/12/12 12:01